L’intelligenza artificiale (IA) e la digitalizzazione stanno ridefinendo il panorama tecnologico e normativo a livello globale. Il recente report dell’Istituto Nazionale di Statistica (ISTAT) esplora il ruolo cruciale dell’IA nella trasformazione digitale delle pubbliche amministrazioni e nella gestione dei dati. Con l’approvazione dell’AI Act da parte dell’Unione Europea, il quadro normativo si evolve per garantire un equilibrio tra innovazione e tutela dei diritti fondamentali.

Ma quali sono le sfide e le opportunità che emergono da questa rivoluzione tecnologica?

Indice

- Il ruolo della digitalizzazione e dell’interoperabilità

- L’Intelligenza artificiale nella gestione dei dati

- L’AI Act e la protezione dei dati

- Sfide e Opportunità per il Futuro

Il ruolo della digitalizzazione e dell’interoperabilità

La digitalizzazione rappresenta il pilastro su cui si fonda l’interoperabilità tra i sistemi informativi, un requisito essenziale per l’efficace gestione dei dati pubblici. L’ISTAT sottolinea come l’integrazione delle tecnologie emergenti permetta di ottimizzare la raccolta e l’analisi dei dati, migliorando l’efficienza amministrativa e riducendo il margine di errore umano. Tuttavia, questa trasformazione impone l’adozione di standard di sicurezza avanzati per prevenire rischi legati alla protezione delle informazioni sensibili.

L’Intelligenza artificiale nella gestione dei dati

Uno degli aspetti più rilevanti del report è l’impiego dell’IA nell’analisi e nella gestione dei dati quantitativi e qualitativi. L’apprendimento automatico e gli algoritmi predittivi stanno rivoluzionando la produzione statistica, consentendo previsioni più accurate e tempestive. L’IA permette di elaborare grandi volumi di dati in tempo reale, identificando pattern complessi e fornendo insight strategici per il decision making.

Grazie alla capacità di autoapprendimento, i modelli di IA possono migliorare continuamente la loro accuratezza e adattarsi a nuove variabili, riducendo al minimo l’intervento umano. Questo approccio si traduce in una maggiore efficienza nelle analisi economiche, nelle previsioni demografiche e nelle valutazioni dei trend di mercato. Inoltre, l’IA viene utilizzata per migliorare la qualità dei dati, rilevando e correggendo errori, riducendo la ridondanza e garantendo una maggiore affidabilità delle informazioni raccolte.

L’AI Act e la protezione dei dati

Tuttavia, l’adozione dell’IA nella gestione dei dati presenta anche delle sfide significative. Il rischio di bias algoritmico, dovuto a dati di addestramento incompleti o distorti, può influenzare negativamente i risultati delle analisi. Per questo motivo, diventa essenziale adottare metodologie di controllo e verifica dei dati, garantendo che gli algoritmi operino in modo equo e trasparente.

Un altro aspetto critico è la protezione della privacy. L’elaborazione di grandi quantità di dati sensibili richiede il rispetto delle normative vigenti in materia di protezione dei dati personali, come il GDPR, e l’implementazione di tecniche di anonimizzazione per tutelare le informazioni individuali. In questo contesto, il ruolo delle istituzioni è cruciale per definire linee guida e standard che assicurino un utilizzo responsabile dell’IA.

Il Regolamento (UE) 2024/1689, noto come AI Act, introduce una regolamentazione stringente per i sistemi di IA, classificandoli in base al livello di rischio. I sistemi ad alto rischio, come quelli impiegati nella gestione delle infrastrutture critiche e nei servizi pubblici essenziali, dovranno rispettare rigorosi standard di sicurezza, trasparenza e accountability.

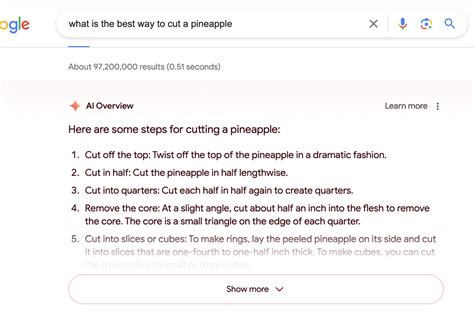

Recentemente, il Garante per la protezione dei dati personali in Italia ha adottato misure significative riguardo all’uso dell’intelligenza artificiale e alla gestione dei dati personali. In particolare, l’applicazione cinese DeepSeek è stata oggetto di attenzione per possibili violazioni delle normative europee sulla protezione dei dati. Dopo una richiesta di informazioni inviata alle società Hangzhou DeepSeek Artificial Intelligence e Beijing DeepSeek Artificial Intelligence, il Garante ha disposto con urgenza ed effetto immediato il blocco del trattamento dei dati degli utenti italiani da parte di DeepSeek.

Questi sviluppi evidenziano l’importanza di una regolamentazione rigorosa nell’uso dell’intelligenza artificiale, soprattutto in relazione alla protezione dei dati personali. Le autorità italiane stanno dimostrando un approccio proattivo nel garantire che le innovazioni tecnologiche rispettino i diritti fondamentali degli individui, sottolineando la necessità di un equilibrio tra progresso tecnologico e tutela della privacy.

Sfide e Opportunità per il Futuro

L’intelligenza artificiale non è più solo una prospettiva futura, ma una realtà già ben radicata nella nostra società. Il suo impatto sulla digitalizzazione e sulla gestione dei dati è ormai ineludibile e destinato a crescere esponenzialmente. Nonostante le preoccupazioni legate alla privacy e ai rischi etici, non si può negare che l’IA rappresenti un’opportunità senza precedenti per migliorare l’efficienza, l’innovazione e la competitività a livello globale.

E’ necessario, quindi, adottare un approccio strategico e lungimirante, capace di bilanciare progresso tecnologico e tutela dei diritti fondamentali. Regolamentazioni come l’AI Act sono essenziali per guidare lo sviluppo responsabile dell’IA, ma altrettanto cruciale è promuovere una cultura dell’innovazione che metta l’accento sulla trasparenza, la sicurezza e il valore aggiunto che l’intelligenza artificiale può offrire alla società.

L’IA non è un nemico da temere, ma uno strumento da governare con intelligenza e responsabilità. Chi saprà cogliere al meglio le sue potenzialità avrà il vantaggio competitivo nel mondo di domani.