Il caso legato alla clonazione della voce del ministro della Difesa Guido Crosetto ha tenuto banco sulle prime pagine dei quotidiani e ha messo in luce la nuova pericolosità dei deepfake, in particolare nell’ambito delle truffe ad alto livello. I truffatori hanno utilizzato la tecnologia del deepfake audio per clonare la voce di Guido Crosetto, con l’intento di ingannare imprenditori e dirigenti di spicco, tra cui Giorgio Armani, Marco Tronchetti Provera e Massimo Moratti che ha versato quasi un milione di euro. Attraverso un software di intelligenza artificiale, i criminali sono riusciti a creare una replica estremamente realistica della voce del ministro, utilizzandola per simulare una richiesta di riscatto per giornalisti italiani presumibilmente ostaggi in zone di conflitto.

Indice

- Ipotesi associazione a delinquere

- E la gente comune?

- L’evoluzione del deepfake e le minacce alla sicurezza

- Come proteggersi dai deepfake: le misure di tutela

- Diritto e Istituzioni in ritardo. Non basta reprimere ma servono investimenti in formazione e competenze

Ipotesi associazione a delinquere

E il numero delle persone contattate dal gruppo che ha tentato le truffe milionarie continua a crescere, così come il numero delle denunce. Sul tavolo della procura di Milano è arrivata la denuncia di Esselunga, altre sono state preannunciate. La querela della famiglia Caprotti si aggiunge a quella dell’imprenditore Massimo Moratti e delle famiglie Aleotti (gruppo Menarini) e Beretta (multinazionale produttrice di armi). Data la complessità della truffa architettata, gli inquirenti indagano anche per l’ipotesi di associazione per delinquere.

L’inganno, che ha spinto le vittime a credere di trovarsi di fronte a una comunicazione ufficiale del governo, solleva interrogativi inquietanti su come questa tecnologia, una volta alla portata di tutti, possa mettere a rischio la sicurezza delle comunicazioni e delle transazioni. Non solo l’intelligenza artificiale permette di clonare voci celebri, ma la sua accessibilità rende queste tecniche di manipolazione potenzialmente devastanti per una vasta fascia della popolazione, che va ben oltre le élite imprenditoriali.

E la gente comune?

Immaginate, ad esempio, un anziano che riceve una telefonata da un “funzionario” con la voce di una persona fidata, chiedendo un pagamento urgente per motivi apparentemente legittimi. La capacità di manipolare l’opinione e le azioni delle persone, sfruttando la verosimiglianza delle voci, è uno dei rischi più concreti dei deepfake. La possibilità che qualcuno cada in trappola in una situazione del genere è estremamente alta, soprattutto in un’epoca in cui la fiducia nelle comunicazioni digitali è sempre più forte.

Questa forma di truffa, alimentata dalla clonazione vocale e visiva, mette a rischio non solo la sicurezza finanziaria degli individui, ma solleva anche serie preoccupazioni in merito alla sicurezza delle comunicazioni stesse. I deepfake, che alterano la percezione della realtà, rappresentano una minaccia crescente, che potrebbe compromettere la fiducia che riponiamo nelle tecnologie digitali.

L’evoluzione del deepfake e le minacce alla sicurezza

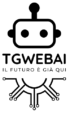

Il deepfake è una tecnologia che permette di manipolare contenuti audiovisivi, creando video o audio artificiali indistinguibili da quelli reali. Se un tempo veniva utilizzata principalmente per scopi ludici o di intrattenimento, oggi sta assumendo una dimensione più sinistra. In contesti politici, finanziari e sociali, i deepfake possono alterare completamente la realtà, manipolare informazioni e persino cambiare l’orientamento delle opinioni pubbliche. L’esempio della truffa al ministro Crosetto dimostra quanto questa tecnologia possa essere facilmente applicata in contesti estremi, come le richieste di riscatto, ma anche in settori meno visibili, dove la manipolazione delle informazioni e dei dati personali può passare inosservata.

Nel caso specifico, la capacità dei truffatori di clonare la voce di un personaggio pubblico ha esposto vulnerabilità impensabili, in particolare la facilità con cui i contatti sensibili tra i protagonisti del mondo imprenditoriale sono stati acquisiti e sfruttati. Ciò dimostra che il pericolo dei deepfake non riguarda solo i personaggi pubblici, ma anche chiunque abbia un’identità digitale.

Come proteggersi dai deepfake: le misure di tutela

Per contrastare la minaccia dei deepfake, sia in ambito privato che pubblico, è essenziale adottare misure di protezione avanzate. I provider digitali, infatti, stanno sviluppando soluzioni sempre più sofisticate per garantire la sicurezza delle transazioni online e la protezione dei dati sensibili. In particolare, nei contesti in cui vengono utilizzati strumenti come la PEC e lo SPID, è fondamentale affidarsi a fornitori che possano garantire la continuità operativa dei processi e la sicurezza delle comunicazioni.

Inoltre, le istituzioni stanno intervenendo per regolamentare l’uso dei deepfake, come testimoniano le Linee Guida della Commissione Europea sull’Intelligenza Artificiale, che raccomandano la trasparenza nell’indicare i contenuti manipolati. Come recita l’art. 52, comma 3, delle linee guida:

“Gli Stati membri dovrebbero adottare misure per garantire che i contenuti generati dall’intelligenza artificiale, in particolare i deepfake, siano chiaramente etichettati come tali. La trasparenza in merito all’uso delle tecnologie di manipolazione è fondamentale per garantire la fiducia dei cittadini nelle informazioni digitali e prevenire l’uso improprio della tecnologia per scopi fraudolenti.”

In Italia, il Garante per la Privacy ha emesso una scheda informativa che aiuta i cittadini a comprendere i rischi legati ai deepfake e fornisce indicazioni pratiche su come proteggersi. Come riportato dal Garante:

“Il fenomeno dei deepfake rappresenta un rischio crescente per la protezione dei dati personali. È essenziale che gli utenti siano consapevoli delle modalità con cui le proprie immagini e voci possono essere manipolate. È consigliato prestare attenzione alle comunicazioni ricevute, specialmente se si tratta di richieste di denaro o informazioni sensibili. In caso di dubbi, è sempre meglio verificare attraverso canali ufficiali.”

Le soluzioni tecnologiche, come quelle sviluppate da InfoCert e Tinexta Cyber, sono esempi concreti di sinergie focalizzate sulla sicurezza informatica, dove esperti e team specializzati in cybersecurity lavorano per prevenire attacchi e garantire la protezione dei dati. Inoltre, sempre più aziende stanno formando team esperti in digital trust per monitorare e contrastare i rischi legati ai deepfake.

Diritto e Istituzioni in ritardo. Non basta reprimere ma servono investimenti in formazione e competenze

I deepfake sono una minaccia che va affrontata con urgenza. Mentre la tecnologia avanza, le istituzioni, le aziende e i cittadini devono essere pronti a reagire in modo efficace per proteggere la propria identità digitale e le proprie risorse. La protezione contro i deepfake richiede non solo soluzioni tecnologiche, ma anche una crescente sensibilizzazione e formazione su come riconoscere e prevenire queste truffe. La risposta delle istituzioni e dei provider digitali deve essere rapida e mirata, per evitare che queste tecnologie diventino strumenti normali di disinformazione e manipolazione. E non è certo sufficiente elaborare linee guida su tecniche proibite, così come sta facendo l’Europa, è necessario investire sulla formazione e sulla consapevolezza dei cittadini che devono sapersi muovere con disinvoltura e senza rischi in un mondo in rapida evoluzione che non consente reazioni tardive.